国产AI芯片生态加速融合,FlagOS镜像入驻腾讯云HAI;小模型驱动智能体落地实践渐成主流。

近年来,随着人工智能技术的迅猛发展,企业和开发者对本地化、自主可控的AI能力需求日益强烈。传统依赖公有云服务的模式,虽然便利,却带来了数据隐私方面的潜在担忧,以及持续的资源消耗压力。在这种背景下,构建能够在本地稳定运行、直接响应各种指令的智能系统,成为推动AI规模化应用的关键路径。开源社区与云平台的深度合作,正逐步为这一转变提供坚实支撑。

众智FlagOS作为一款完全开源的AI系统软件栈,专为多种异构AI芯片设计,支持模型与智能体的高效部署与迁移。该软件栈通过统一接口与核心组件,实现跨硬件平台的无缝适配,大幅简化了从开发到上线的全流程。本次合作中,FlagOS联合腾讯云HAI社区,将经过优化的Qwen3-4B-hygon-flagos模型镜像正式上线。开发者只需简单拉取,即可在兼容加速卡上快速搭建FlagOS结合OpenClaw的环境,从而驱动小型模型执行复杂任务。这种方案为从云端API转向自建本地服务的转型,提供了可靠的落地参考。

实际部署过程清晰明了,首先聚焦于模型镜像的获取与容器启动。以ModelScope等平台为例,用户可轻松下载相关权重。随后,通过HAI社区提供的拉取命令,启动专用容器。这一过程支持自定义容器名称,便于多实例管理。FlagOS的跨芯适配能力,确保了模型在不同硬件上的稳定表现,为后续智能体集成奠定基础。整个安装环节注重简便性,让具备基本容器经验的开发者也能快速上手。

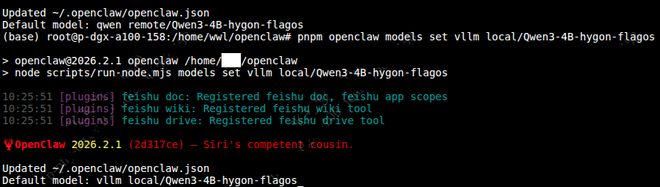

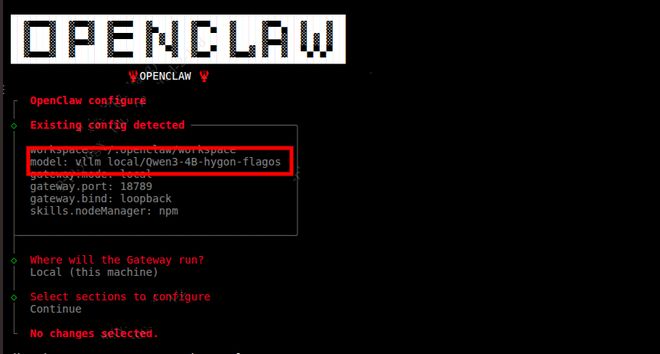

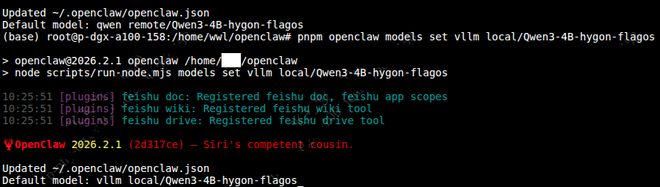

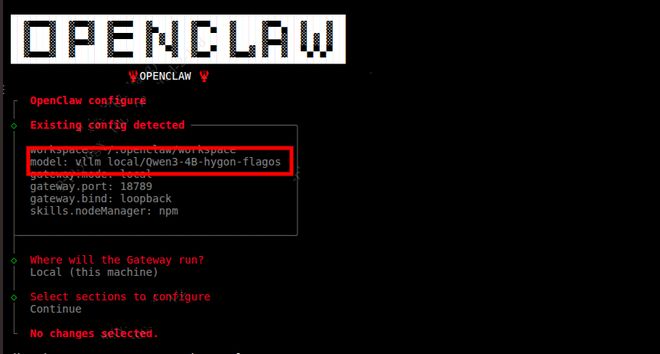

接下来是OpenClaw的安装与配置环节。OpenClaw作为一款开源的多通道AI智能体框架,支持多种即时通讯平台接入,能够实现工具调用、文件操作等高级功能。通过源码方式安装后,用户需调整配置文件,将本地模型指定为加速推理工具驱动的选项。配置完成后,系统会清晰显示模型切换状态,默认模型成功更新为Qwen3-4B-hygon-flagos。这一变化标志着小型模型已逐步承担起智能体执行层面的核心职责,而非仅限于对话生成。

进一步扩展应用场景,可将通道配置为常见即时通讯工具。通过参考相关文档,替换必要的认证信息后,启动网关服务。如此一来,智能体便能稳定接入相应平台,处理日常指令与协作需求。在实际测试中,小型模型展现出对指令理解、工具调度以及本地资源管理的良好支持。这表明,Agent能力的提升边界,正逐步从单纯的模型规模,转向系统工程设计、接口抽象与权限管理的优化。平台层面的持续完善,往往比单纯增大参数更具决定性影响。

展望未来,随着更多类似开源项目与云服务的融合,本地化AI部署将变得愈发成熟。小型模型在执行层面的稳定表现,为企业和个人开发者提供了更务实的选择。FlagOS社区持续推动统一软件栈建设,致力于打破芯片间生态壁垒,实现一次开发、多平台运行的愿景。腾讯云HAI则通过容器镜像中心,提供即用级资源,助力快速验证与迭代。两者合力,正加速构建开放、高效的AI基础设施生态,让更多创新力量参与其中,推动人工智能向更自主、更普惠的方向迈进。

关于众智FlagOS社区,该项目聚焦异构AI芯片的统一支持,涵盖算子库、编译器、并行框架等多个核心模块。通过开放协作,社区汇聚产学研各方力量,致力于释放硬件潜能。官网及代码仓库为开发者提供全面资源。HAI作为面向AI与科学计算的GPU服务产品,集成丰富镜像与工具,显著降低部署门槛。此次合作,正是开源生态与云平台协同的生动体现。